Sie haben vielleicht schon von Prompt Engineering gehört oder auch nicht. Im Wesentlichen geht es darum, 'effektive Kommunikation mit KI, um das zu erreichen, was man möchte'.

Die meisten Menschen wissen nicht, wie man gute Anzeigen formuliert.

Allerdings wird es zunehmend zu einer wichtigen Fähigkeit...

Denn Müll rein = Müll raus.

Hier sind die wichtigsten Techniken, die Sie für die Unterstützung benötigen 👇

Ich werde ein Sprachmodell als 'LM' bezeichnen.

Beispiele für Sprachmodelle sind ChatGPT von @OpenAI und Claude von @AnthropicAI.

1. Persona/Rollenanforderung

Eine Rolle dem KI zuweisen.

Beispiel: "Du bist ein Experte in X. Du hast Menschen seit 20 Jahren dabei geholfen, Y zu tun. Deine Aufgabe ist es, die besten Ratschläge zu X zu geben.

Antworte mit 'verstanden', wenn das klar ist."

Ein leistungsstarkes Add-On ist das Folgende:

„Du musst immer Fragen stellen, bevor du antwortest, damit du besser verstehen kannst, wonach der Fragende sucht.“

Ich werde gleich darauf eingehen, warum das so wichtig ist.

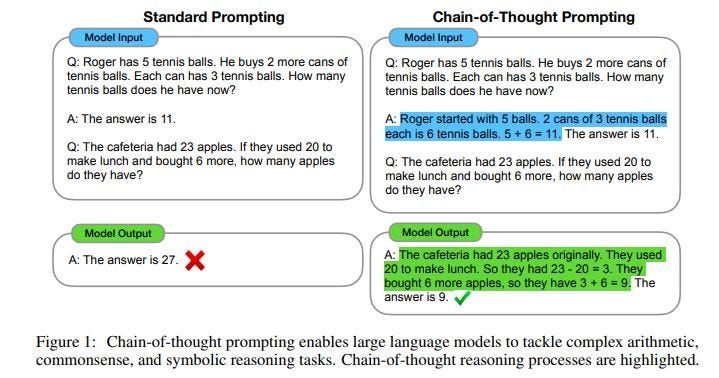

2. CoT

CoT steht für 'Chain of Thought'

Es wird verwendet, um den Logikmodul anzuweisen, seine Argumentation zu erklären.

Beispiel:

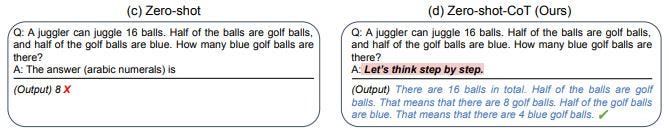

3. Zero-shot-CoT

Zero-shot bezieht sich auf ein Modell, das Vorhersagen ohne zusätzliches Training innerhalb der Vorgabe macht.

Ich komme gleich zum Thema Few-Shot.

Bitte beachten Sie, dass in der Regel CoT > Zero-Shot-CoT

Beispiel:

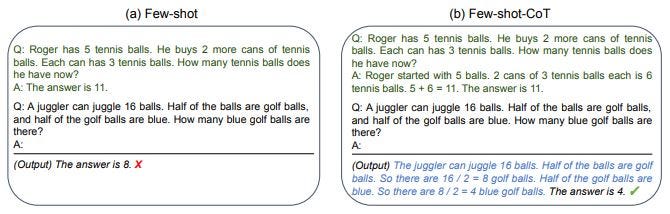

4. Few-shot (und Few-shot-CoT)

Im Few-shot-Ansatz erhält das LM (Sprachmodell) einige Beispiele in der Eingabe, damit es sich schneller an neue Beispiele anpassen kann.

Beispiel:

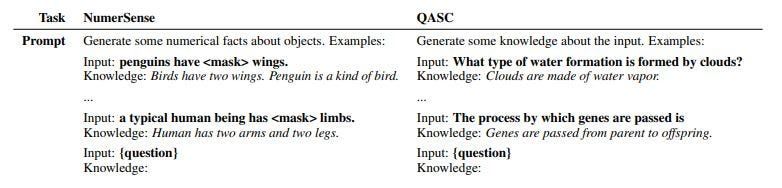

5. Wissensgenerierung

Generierung von fragebezogenem Wissen durch Aufforderung an ein LM.

Dies kann für eine generierte Wissensfrage verwendet werden (siehe unten).

Beispiel:

6. Generiertes Wissen

Jetzt, da wir Wissen haben, können wir diese Informationen in einer neuen Aufforderung verwenden und Fragen stellen, die mit dem Wissen zusammenhängen.

Ein solche Frage wird als "wissensgestützte" Frage bezeichnet.

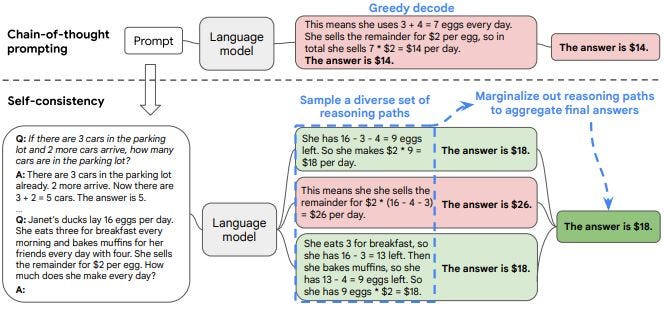

7. Selbstkonsistenz

Diese Technik wird verwendet, um mehrere Denkpfade (Gedankenketten) zu erzeugen.

Die Mehrheitsantwort wird als endgültige Antwort akzeptiert.

Beispiel:

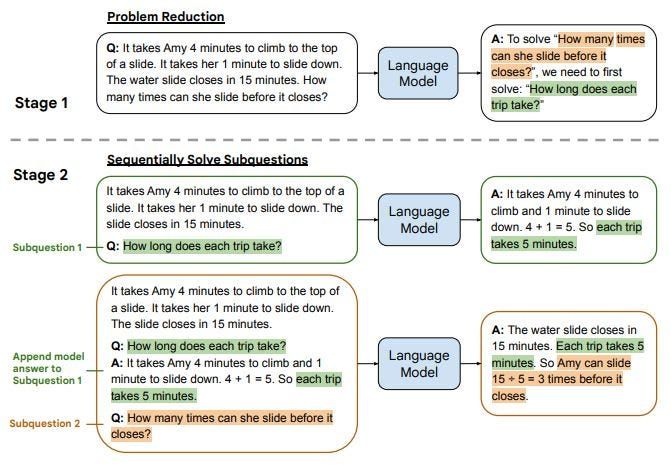

8. LtM

LtM steht für 'Von Geringstem zu Höchstem'

Diese Technik ist eine Fortsetzung von CoT. Darüber hinaus arbeitet sie, indem sie ein Problem in Teilprobleme aufteilt und diese dann löst.

Beispiel: